Producenci smartfonów prześcigają się w podnoszeniu rozdzielczości matryc ich aparatów. W tym roku na rynek trafiły pierwsze smartfony z matrycami 200 megapikseli – najpierw Motorola edge 30 Ultra i Xiaomi 12T Pro, niedługo potem Infinix Zero Ultra. W tym materiale chcemy rozwiać wszystkie wątpliwości, które się z tym wiążą. Ile w tym marketingu i wyścigu na duże liczby w specyfikacji, a ile faktycznego poprawiania jakości obrazu? Sprawa wcale nie jest taka prosta.

Matryca formatu A4 lub A3?

Najpierw ustalmy nasz punkt wyjścia - jak wyglądałaby idealna, bezkompromisowa matryca aparatu, dająca najlepsza jakość obrazu? W idealnym świecie, pozbawionym kompromisów w grę wchodzą dwa czynniki: wielkość pikseli i liczba pikseli. Im pojedynczy piksel na matrycy ma fizycznie większy rozmiar, tym więcej gromadzi światła, co z kolei owocuje lepszym stosunkiem sygnału do szumu, czyli czystszym obrazem. Im więcej tych pikseli mamy, tym więcej możemy zarejestrować szczegółów.

Można wykonać proste ćwiczenie i ułożyć kształt litery S z kwadratowych klocków. Z trzech nam się to nie uda, kształt będzie nierozpoznawalny, bo zbyt uproszczony. W miarę dodawania kolejnych klocków będziemy mogli utworzyć coraz dokładniejsze przybliżenie krzywej, aż w końcu nie będziemy w stanie rozróżnij tysięcy użytych elementów.

Dlatego bezkompromisowa matryca ma dużo pikseli, które mają duże rozmiary. Im większa matryca tym lepsza - najlepiej formatu A4 albo A3 – takie rozmiary mają matryce niektórych teleskopów badawczych.

Takie matryce nie nadają się jednak oczywiście do użycia w smartfonach ze względu na swój rozmiar i cenę. Wówczas pojawia się niełatwe pytanie – mając narzucone odgórnie ograniczenie co do wielkości matrycy, ile możemy upchnąć na niej coraz mniejszych pikseli, aby było to z korzyścią dla jakości, a nie przyczyną jej pogorszenia? Ten punkt przecięcia się zysków i strat nie jest stały i wraz z rozwojem technologii przesuwa się w stronę wyższej rozdzielczości.

O co chodzi w wysokiej rozdzielczości?

Pierwszą podpowiedzią powinno być, że niezależnie od rozdzielczości matrycy wszystkie telefony zapisują zdjęcia zwykle w rozdzielczości około 12 megapikseli. Aby zapisać zdjęcie z pełną rozdzielczością matrycy trzeba skorzystać ze specjalnego trybu, zwykle ukrytego głębiej pośród trybów dodatkowych. Nie chodzi więc o zapisanie wysokiej rozdzielczości, lecz o jej zmniejszenie w taki sposób, aby wyciągnąć z tego dodatkowe korzyści dla jakości obrazu.

Znamy cztery szerokie kategorie technik pozwalające przejść od wysokiej rozdzielczości do mniejszej w kolejności od najprostszego do najbardziej skomplikowanego, ale jakościowo najlepszego:

- Cropping

- Line skipping

- Pixel Binning

- Oversampling

Crop, czyli wycięcie fragmentu zdjęcia

W tej technice bierzemy cały kadr, wybieramy jego mniejszy fragment i resztę pikseli odrzucamy. Jest to operacja najmniej wymagająca obliczeniowo i najszybsza, ale też owocując najniższą jakością finalnego obrazu – nie robimy żadnego użytku z odrzucanych pikseli. Skutkiem cropu jest zmiana powiększenia. Wszelkie niedoskonałości, które mogą być niewidoczne przy dużej rozdzielczości zostają powiększone i uwypuklone. Jest to jednak jeden ze sposobów w jaki wyższą rozdzielczość matrycy można wykorzystać – do większego powiększenia cyfrowego, czyli potocznie mówiąc do cyfrowego zoomu. Mimo pogorszenia jakości obrazu względem pełnego kadru, to wciąż będzie lepszej jakości powiększenie niż wycinanie fragmentu ze zdjęcia o niskiej rozdzielczości.

Line skipping - pomijamy linie

Line skipping, jak sama nazwa wskazuje, to pomijanie linii pikseli. Zależnie od stopnia zmniejszania rozdzielczości można pominąć co drugą linię i zmniejszyć rozdzielczość o połowę lub zastosować inne proporcje. Pozwala to najniższym kosztem zmniejszyć rozdzielczość bez zmiany powiększenia jak w cropie. Ta technika ma zastosowanie niemal wyłącznie podczas nagrywania wideo i nie jest stosowana podczas fotografowania. W urządzeniach wyposażonych w wystarczająca moc obliczeniową nie stosuje się jej także podczas nagrywania wideo i coraz bardziej staje się ona reliktem przeszłości.

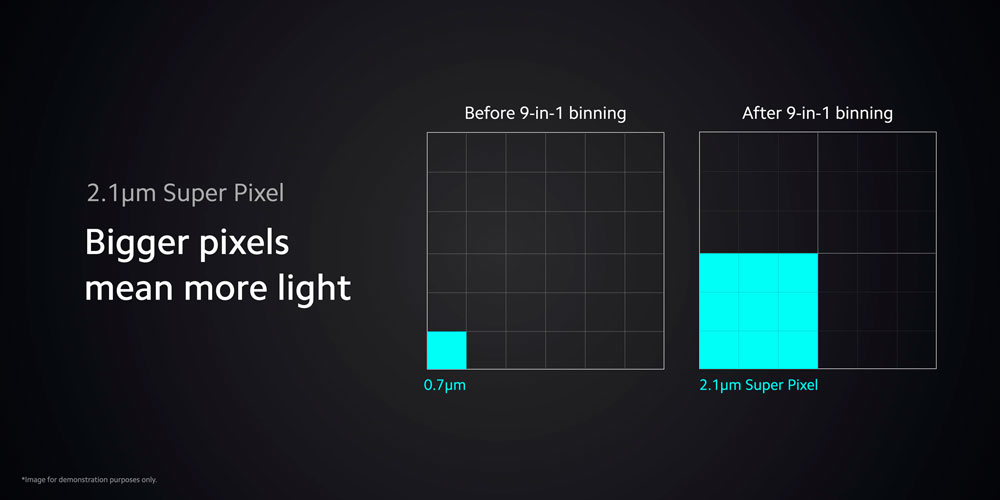

Pixel Binning - łączymy piksele

To jest metoda, która obecnie jest stosowana przez producentów wykorzystujących matryce o wysokiej rozdzielczości. Polega na łączeniu grup pikseli w jeden większy piksel, uśredniając informację w nich zawartą. W ten sposób można minimalizować szum.

Z tego właśnie powodu często wysokie rozdzielczości matryc są wielokrotnościami wyjściowych 12 megapikseli – iPhone 14 Pro z 48 megapikselami w głównym aparacie łączy 4 piksele w jeden, bo 4x12 to 48, a Samsung ma w swoich flagowcach matrycę 108 megapikseli, bo 9x12=108.

12 megapikseli wzięło się stąd, że to była i jest najpowszechniej wykorzystywana rozdzielczość matrycy bez zmiany rozdzielczości przed zapisaniem pliku. Możliwe są jednak inne kombinacje i z 200 megapikseli łącząc po 16 pikseli w jeden można uzyskać 12,5 megapiksela.

Technologia Pixel Binning jest wciąż rozwijana i droga do polepszenia jakości biegnie dwutorowo. Druga opcja to bardziej zaawansowane algorytmy łączenia pikseli przez nadawanie im różnej wagi w procesie uśredniania informacji każdego z nich. Tutaj droga do rozwoju algorytmów jest ograniczona jedynie przez pomysłowość inżynierów i moc obliczeniową. Tak jak powstają coraz lepsze tryby nocne i portretowe, tak możliwe jest ciągłe poprawianie algorytmów Pixel Binning do uzyskania coraz lepszych efektów, choć tutaj postępy będą jednak mniej spektakularne niż w przypadku zdjęć nocnych.

To właśnie Pixel Binning nadał sens matrycom o wysokiej rozdzielczości. Nie jest to jednak najlepszy sposób zmiany rozdzielczości.

Oversampling - 100% jakości z matrycy

Oversampling oznacza każdorazowe zapisanie 100% informacji z matrycy, a następnie na tej podstawie wykonywanie algorytmów pomniejszających obraz, bez drogi na skróty w postaci łączenia wielu pikseli w jeden na etapie rejestracji obrazu. Pozwala to na osiągnięcie optymalnego efektu i wykorzystanie całej informacji, ale jest też najbardziej obciążające obliczeniowo. Najpierw obraz musi zostać zarejestrowany w pamięci co nawet w formacie JPG dla rozdzielczości 200 megapikseli oznacza 50 – 60 MB na jedno zdjęcie i jeszcze wielokrotnie więcej gdybyśmy chcieli zapisać obraz w bezstratnym formacie RAW. Kolejnym krokiem jest pomniejszenie zdjęcia korzystając z jednego z algorytmów, który kładzie nacisk różne cechy – wygładza gradient albo nadaje priorytet szczegółom. Efekt jest jednak lepszy niż w przypadku Pixel Binning, co pokazałem na przykładzie Motoroli edge 30 ultra. Porównaliśmy zdjęcia zapisane przez telefon automatycznie do domyślnej rozdzielczości 12 megapikseli w technice Pixel Binning do zdjęć wykonanych tym samym telefonem w pełnej rozdzielczości i zmniejszając je na komputerze również do 12 megapikseli wykorzystując oversampling.

Powody dla którego smartfony z tego nie korzystają są dwa. To moc obliczeniowa i miejsce w pamięci. Nawet jeśli telefon jest w stanie wykonać te operacje to znacznie szybciej rozładowywałby swoją baterię. Drugi może nawet istotniejszy powód to opóźnienia. Wykonanie zdjęcia w pełnej rozdzielczości samo w sobie wymaga więcej czasu. W przypadku Motoroli różnica jest bardzo odczuwalna, a nie uwzględnia to jeszcze czasu koniecznego na dokonanie obliczeń oversamplingu.

Łączenie technik

Należy podkreślić, że możliwe jest również łączenie technik opisanych wyżej. Zoom cyfrowy może najpierw wykonać crop z 200 megapikseli do niższej rozdzielczości, która wciąż jednak będzie wyższa niż finalne zdjęcie. Wówczas Pixel Binning połączy ze sobą piksele w grupy, mniejsze niż w przypadku całego kadru bez powiększenia i przeskaluje obraz do finalnej rozdzielczości 12 megapikseli.

Podsumowanie

Znaczne zwiększenie rozmiaru matrycy nie jest możliwe w urządzeniu mobilnym. Wymusiło to poszukiwanie innej drogi. Jednocześnie ograniczenia mocy obliczeniowej, opóźnień i zużycia energii przynajmniej na razie powodują, że zastosowanie bezkompromisowej techniki oversamplingu też nie jest jeszcze możliwe. Stąd odczuwane korzyści ze zwiększania rozdzielczości nie są liniowo proporcjonalne do podnoszenia tej rozdzielczości i 200 megapikseli nie przynosi dwukrotnie lepszego, bardziej szczegółowego obrazu w porównaniu matrycy 100 megapikseli. Poprawa jakości jest wypadkową równoważących się czynników: coraz większego szumu mniejszych pikseli i coraz lepszych algorytmów łączenia pikseli w ekonomiczny obliczeniowo sposób jakim jest Pixel Binning. Dlatego nie ma prostej odpowiedzi jak dużej rozdzielczości matryca da najlepszy jakościowo obraz – zależy to od konkretnej implementacji danego producenta i od algorytmów jakie opracował. Nie jest ani tak, że zwiększanie rozdzielczości nic nie daje, ani tak, że samo w sobie jest receptą na sukces.